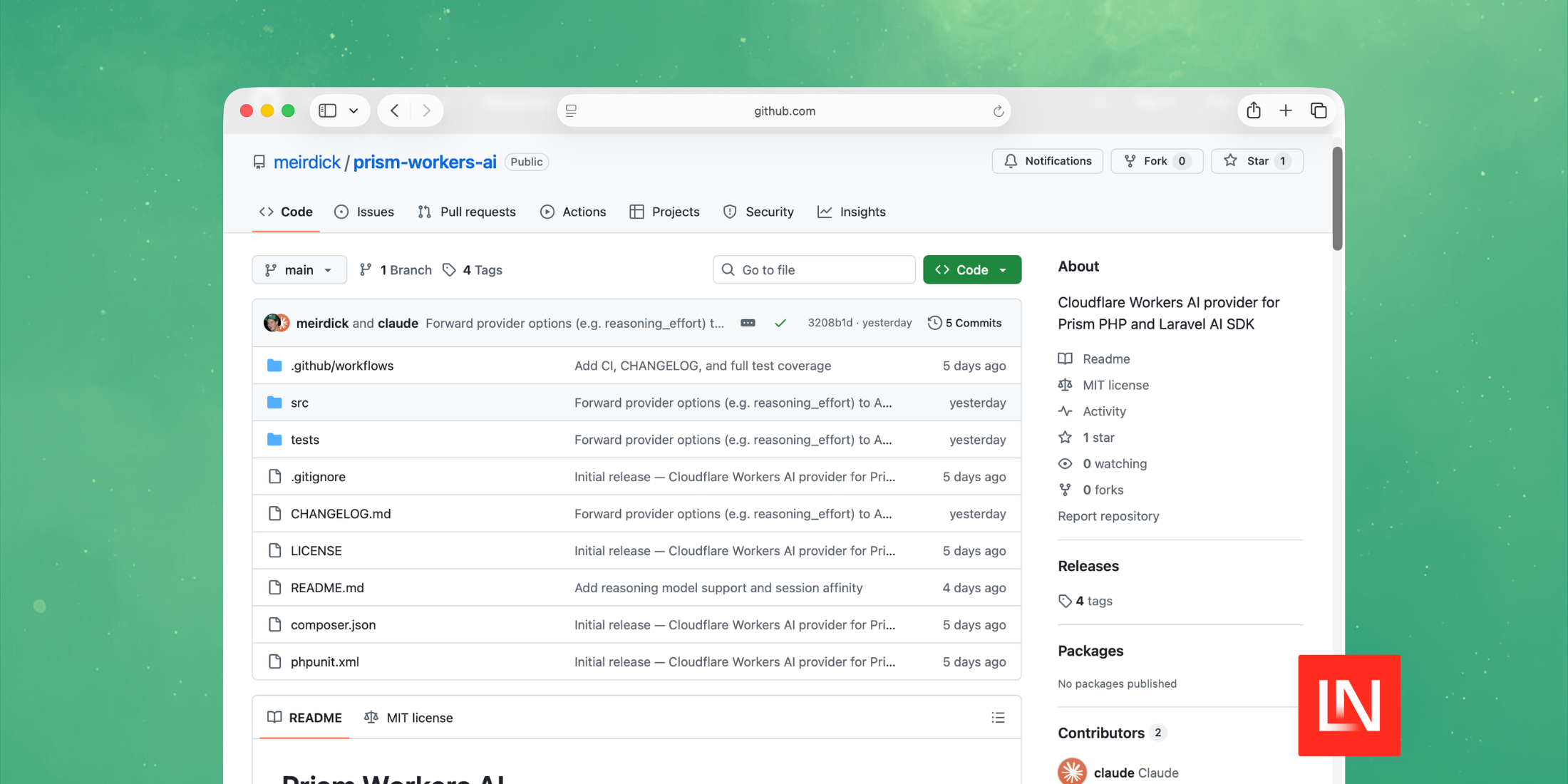

Prism Workers AI 是 Cloudflare Workers AI 的提供商。

Prism PHP

和

Laravel AI SDK

它将请求路由到 Cloudflare 的 AI 网关。

/compat

端點。

- 生成自然语言文本、结构化输出和流式响应。

- 使用 Cloudflare 嵌入模型创建矢量表示。

- 通过支持复杂的多步骤工作流程,实现工具执行自动化。

- 从支持的推理模型中提取和利用推理内容。

- 利用会话亲和性进行提示前缀缓存,以维护对话上下文。

- 与 Prism PHP 和 Laravel AI SDK 的 agent() 助手兼容。

文本生成和流媒体

通过 Prism 的流畅 API,使用任何 Workers AI 模型生成文本:

使用

棱镜\棱镜\立面\棱镜

;$响应

=

棱镜

::

文本

()

->

使用

(

'workers-ai'

,

'workers-ai/@cf/meta/llama-3.3-70b-instruct-fp8-fast'

)

->

提示

(

'你好!'

)

->

asText

();流媒体的工作原理也一样:

$stream

=

棱镜

::

文本

()

->

使用

(

'workers-ai'

,

'workers-ai/@cf/meta/llama-3.3-70b-instruct-fp8-fast'

)

->

提示

(

给我讲个故事吧

)

->

asStream

();嵌入

与 Prism 内置的 xAI 驱动程序不同,该软件包支持嵌入:

$响应

=

棱镜

::

嵌入

()

->

使用

(

'workers-ai'

,

'workers-ai/@cf/baai/bge-large-en-v1.5'

)

->

来自输入

(

'你好世界'

)

->

产生

();工具调用

该软件包支持多步骤工作流程中的工具调用。Workers AI 需要

content

即使在工具调用响应期间为空,也要始终在助手消息中显示——此软件包会自动处理这种情况:

$响应

=

棱镜

::

文本

()

->

使用

(

'workers-ai'

,

'workers-ai/@cf/meta/llama-3.3-70b-instruct-fp8-fast'

)

->

使用工具

([$weatherTool])

->

withMaxSteps

(

3

)

->

提示

(

“天气怎么样?”

)

->

asText

();具有思维内容的推理模型

该软件包从 Kimi K2.5 等推理模型中提取推理内容。推理链与最终响应一起提供:

$响应

=

棱镜

::

文本

()

->

使用

(

'workers-ai'

,

'workers-ai/@cf/moonshotai/kimi-k2.5'

)

->

使用最大代币

(

2000

)

->

提示

(

15乘以37等于多少?

)

->

asText

();$响应

->

文本;

// "555"$响应

->

步骤[

0

]

->

附加内容[

'思维'

];// “用户正在请求 15 和 37 的乘积……”在流式传输过程中,您会在文本输出之前收到思考事件:

$stream

=

棱镜

::

文本

()

->

使用

(

'workers-ai'

,

'workers-ai/@cf/moonshotai/kimi-k2.5'

)

->

使用最大代币

(

2000

)

->

提示

(

请简要解释一下为什么天空是蓝色的。

)

->

asStream

();foreach

($stream

作为

$event) {

// ThinkingStartEvent、ThinkingEvent(增量)、ThinkingCompleteEvent

// 然后是 TextStartEvent、TextDeltaEvent、TextCompleteEvent}放

withMaxTokens(2000)

使用推理模型时,则应更高,因为推理标记会占用限制。

Laravel AI SDK 集成

如果你使用

laravel/ai

该软件包还注册了一个

workers-ai

司机:

使用

功能

Laravel\Ai\agent

;$响应

=

代理人

(

指示

:

“你真是个得力的助手。”

)

->

迅速的

(

'你好!'

,

提供者

:

'workers-ai'

(英文):您可以在 GitHub 上了解更多关于此软件包的信息: meirdick/prism-workers-ai 。

注意:该软件包需要 PHP 8.2+ 和 Prism PHP ^0.99,并可选支持 Laravel AI SDK ^0.3。